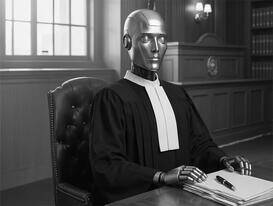

Responsabilité des systèmes d’intelligence artificielle : quand ChatGPT est poursuivi pour exercice illégal de la profession d’avocat

Dans une complaint déposée le 4 mars 2026 devant la juridiction fédérale du district nord de l’Illinois, la société Nippon Life Insurance Company of America poursuit OpenAI Foundation et OpenAI Group PBC en responsabilité civile.

La demanderesse reproche au système ChatGPT d’avoir fourni à l’une de ses assurées une assistance juridique personnalisée qui aurait conduit cette dernière à violer un accord transactionnel définitif et à multiplier des recours infondés, causant à Nippon des frais de défense significatifs. La complaint invoque trois fondements : l’interférence délictuelle avec un contrat, l’abus de procédure et l’exercice illégal de la profession d’avocat au regard du droit de l’Illinois, assortis d’une demande d’injonction et de dommages-intérêts punitifs.

L’affaire soulève trois questions structurantes pour le droit de la responsabilité appliqué à l’intelligence artificielle (IA) générative : celle de la qualification de l’activité du système, celle du lien de causalité entre la réponse générée et le dommage subi par le tiers, et celle du rôle des politiques d’usage comme éléments d’appréciation de la faute du fournisseur. Si elle ne consacre pas en l’état un régime de responsabilité nouveau, elle témoigne de la capacité du droit commun à appréhender ces situations, et annonce le type de contentieux que les juridictions auront à trancher à mesure que ces systèmes produiront des réponses plus prescriptives et plus déterminantes pour leurs utilisateurs.

L’essor des assistants fondés sur l’intelligence artificielle générative suscite une interrogation juridique croissante : leur capacité à produire des analyses, des stratégies procédurales et des actes de procédure les expose-t-elle à une responsabilité propre, distincte de celle de leurs utilisateurs ? La complaint (plainte) déposée le 4 mars 2026 devant la juridiction fédérale du district nord de l’Illinois par la société Nippon Life Insurance Company of America (ci-après « Nippon ») contre OpenAI Foundation et OpenAI Group PBC s’inscrit directement dans cette problématique. Pour la première fois, un assureur engage une action civile contre un fournisseur d’IA au motif que son chatbot aurait assisté une partie à un litige de manière illicite, causant un préjudice économique direct à un tiers.

L’affaire retient l’attention moins par sa singularité factuelle que par le déplacement qu’elle opère : le fournisseur d’IA n’est plus seulement critiqué pour des erreurs de contenu, mais recherché comme acteur ayant contribué à des initiatives procédurales jugées abusives.

Une assistance juridique automatisée au cœur du litige

Une assurée, titulaire d’une police souscrite auprès de Nippon, avait engagé un litige contre la compagnie, lequel avait été définitivement résolu par la conclusion d’un accord transactionnel. Cet accord, revêtu d’une force obligatoire, emportait renonciation à toute action future relative au même objet.

Postérieurement à la signature de cet accord, l’assurée aurait eu recours à ChatGPT pour obtenir une assistance à caractère juridique. Selon les termes de la complaint, le système d’IA lui aurait fourni des analyses relevant du droit des assurances, des argumentaires juridiques ainsi que des projets d’actes de procédure destinés à rouvrir le litige pourtant éteint par l’accord transactionnel. Sur le fondement de ces éléments générés automatiquement, l’utilisatrice aurait multiplié des dépôts de pièces et des demandes dépourvues de fondement.

La demanderesse soutient en conséquence que ChatGPT aurait exercé de facto le rôle d’un conseil juridique, en dehors de tout cadre déontologique et sans les responsabilités propres à un avocat régulièrement inscrit au barreau.

La qualification de l’activité reprochée : information ou pratique du droit ?

Le premier intérêt du dossier tient à la qualification de l’activité imputée au système d’IA. La complaint ne vise pas une simple restitution documentaire ou une agrégation de sources. Elle allègue que ChatGPT aurait rédigé des actes de procédure, conduit des recherches juridiques ciblées, fourni une analyse appliquée à la situation de l’utilisatrice et délivré des conseils orientant sa stratégie contentieuse. La distinction est juridiquement décisive.

Tant que le système demeure un instrument d’accès à l’information juridique générale, la question se ramène principalement à la fiabilité et à l’exactitude du contenu restitué. La situation est substantiellement différente lorsque le système individualise sa réponse, propose une stratégie adaptée à un litige déterminé, applique des règles de droit à des faits concrets et produit des écritures destinées à être soumises à une juridiction. Dans cette hypothèse, le système cesse d’être un outil de documentation pour s’apparenter, dans ses effets, à la prestation d’un professionnel du droit et sans en supporter les obligations ni en assumer les responsabilités.

C’est précisément sur ce terrain que la complaint entend placer le débat. Le critère pertinent ne serait pas la sophistication technique du modèle, mais le degré auquel son intervention se substitue, en pratique, à l’exercice d’une activité réservée. Cette approche fonctionnelle, qui privilégie l’effet produit sur l’utilisateur plutôt que la nature intrinsèque de l’outil, est cohérente avec la manière dont les juridictions américaines ont traditionnellement apprécié l’unauthorized practice of law (exercice illégal de la profession d’avocat) : en se concentrant sur la réalité de la relation de conseil et non sur la qualité formelle de celui qui la dispense. Appliquée à un système d’IA, elle conduit à poser une question que le droit positif n’a pas encore tranchée : à partir de quel seuil d’individualisation et d’influence sur la décision de l’utilisateur, un modèle de langage doit-il être traité comme un prestataire de services juridiques au sens du droit de la responsabilité ?

La question centrale du lien de causalité

Le deuxième intérêt du contentieux est d’ordre probatoire. Pour établir la responsabilité d’OpenAI, Nippon entreprend de reconstituer le rôle effectivement joué par ChatGPT dans la conduite procédurale de l’assurée. La complaint s’appuie à cette fin sur des captures d’écran des échanges avec le système, sur des similitudes formelles entre les productions de l’outil et les écritures effectivement déposées, ainsi que sur des indices tirés de la structure et de la présentation des documents soumis à la juridiction. La démonstration demeure, à ce stade, unilatérale et non contredite. Elle met néanmoins en lumière une difficulté probatoire structurelle que tout contentieux de ce type aura à affronter.

La responsabilité du fournisseur d’IA ne saurait en effet reposer sur la seule caractérisation d’une autonomie abstraite du système. Elle suppose d’établir, concrètement et dans l’ordre causal, un lien entre la réponse générée par le modèle, la décision prise par l’utilisateur sur le fondement de cette réponse, et le dommage dont le tiers demande réparation. Or cette chaîne causale est par nature difficile à objectiver : l’utilisateur reste libre d’écarter, de reformuler ou d’ignorer les productions du système ; il peut consulter d’autres sources ; il peut agir pour des motifs indépendants du contenu qui lui a été restitué. L’intervention humaine intermédiaire, inhérente à tout usage d’un assistant IA, constitue ainsi un facteur de rupture potentielle du lien causal que les défendeurs ne manqueront pas d’invoquer.

La question n’est donc pas seulement de déterminer si le système a délivré un conseil au sens fonctionnel du terme, mais d’établir que ce conseil a effectivement déterminé l’acte litigieux et les coûts qui en ont résulté pour la demanderesse. Cette exigence causale, classique en droit de la responsabilité civile, prend une dimension particulière appliquée aux systèmes d’IA générative. En effet, comme les sorties sont probabilistes, contextuelles et non reproductibles à l’identique, cela complique singulièrement toute reconstitution a posteriori du rôle qu’elles ont pu jouer dans la formation de la volonté de l’utilisateur.

Le rôle des politiques d’usage et des garde-fous contractuels

Le troisième apport du dossier tient à la place que les conditions contractuelles d’utilisation sont appelées à occuper dans le débat sur la responsabilité du fournisseur. La complaint relève qu’OpenAI a, postérieurement aux faits allégués, resserré ses politiques d’utilisation afin d’interdire expressément le recours à ChatGPT pour la fourniture de conseils juridiques personnalisés. Cet élément est mobilisé par la demanderesse comme indice de la conscience qu’avait le fournisseur du risque d’usage : la modification ultérieure des conditions d’utilisation traduirait la reconnaissance implicite que l’usage antérieur n’était pas encadré de manière adéquate.

L’argument n’est pas sans portée, mais il appelle une réserve de méthode. Des conditions générales d’utilisation, fussent-elles restrictives, ne définissent pas par elles-mêmes la nature juridique du service fourni, et ne sauraient, à elles seules, caractériser un exercice illégal de la profession d’avocat au sens du droit positif. La qualification légale d’une activité procède de critères objectifs que la volonté contractuelle du prestataire ne peut ni créer ni effacer. OpenAI pourra en outre faire valoir que les avertissements figurant dans ses conditions d’utilisation, qui rappellent notamment que les réponses du système ne constituent pas un conseil juridique et ne sauraient s’y substituer, suffisaient à informer l’utilisateur des limites du service.

Ces éléments n’en demeurent pas moins susceptibles de peser significativement dans l’appréciation de plusieurs questions connexes : la prévisibilité du risque d’usage détourné, le caractère adéquat des mesures de prévention mises en œuvre par le fournisseur, et, plus largement, la diligence attendue d’un opérateur dont les systèmes sont déployés à grande échelle dans des domaines à fort enjeu pour les tiers. À cet égard, les politiques d’usage et les garde-fous techniques cessent d’être de simples stipulations contractuelles pour devenir des éléments d’appréciation de la faute, au même titre que les standards de prudence et de diligence reconnus en droit de la responsabilité civile.

Une affaire révélatrice des contentieux à venir

Pour le juriste, qu’il soit de tradition française ou de common law, cette affaire présente avant tout un intérêt de méthode. Elle ne consacre pas, en l’état, une responsabilité de principe des fournisseurs de modèles génératifs pour les actes procéduraux de leurs utilisateurs. Elle témoigne plutôt d’une tentative de rattacher l’intervention d’un système d’IA à des catégories juridiques éprouvées (responsabilité contractuelle et délictuelle, abus de procédure, exercice illégal d’une profession réglementée) en l’absence de tout régime spécifique applicable.

Sa portée n’est donc pas de réformer le droit de la responsabilité civile, mais de démontrer que les qualifications existantes peuvent être mobilisées, avec une certaine cohérence, face à des outils conversationnels dont les réponses sont de plus en plus individualisées et orientées vers l’action. Cette plasticité du droit commun n’est pas sans limites : les catégories classiques ont été construites pour appréhender des comportements humains, et leur application à des systèmes automatisés soulève des questions d’adaptation que la présente procédure ne résoudra probablement pas à elle seule.

L’affaire annonce néanmoins le type de contentieux que les juridictions, américaines comme européennes, auront à trancher à mesure que ces systèmes produiront des réponses plus contextualisées, plus prescriptives et plus déterminantes pour les décisions de leurs utilisateurs. Dans cette perspective, le critère décisif de la responsabilité du fournisseur pourrait être moins la sophistication technique du modèle ou la nature formelle du service proposé, que le degré auquel le système se substitue, dans ses effets concrets, à l’activité d’un professionnel dont l’exercice est réglementé. C’est à cette condition que le droit de la responsabilité civile pourra remplir, à l’égard des systèmes d’IA générative, la fonction régulatrice qui est la sienne.

par Eléonore Favero Agostini, Associée

© Lefebvre Dalloz